MIG – Multi-Instance GPU là gì?

Có lẽ bạn đã từng nghe đến khái niệm Multi Instance GPU rồi phải không? Vậy Multi Instance GPU là gì? Lợi ích mang đến như thế nào? Hãy cùng Shop máy chủ tìm hiểu các vấn đề này nhé.

Khái niệm MIG – Multi Instance GPU là gì?

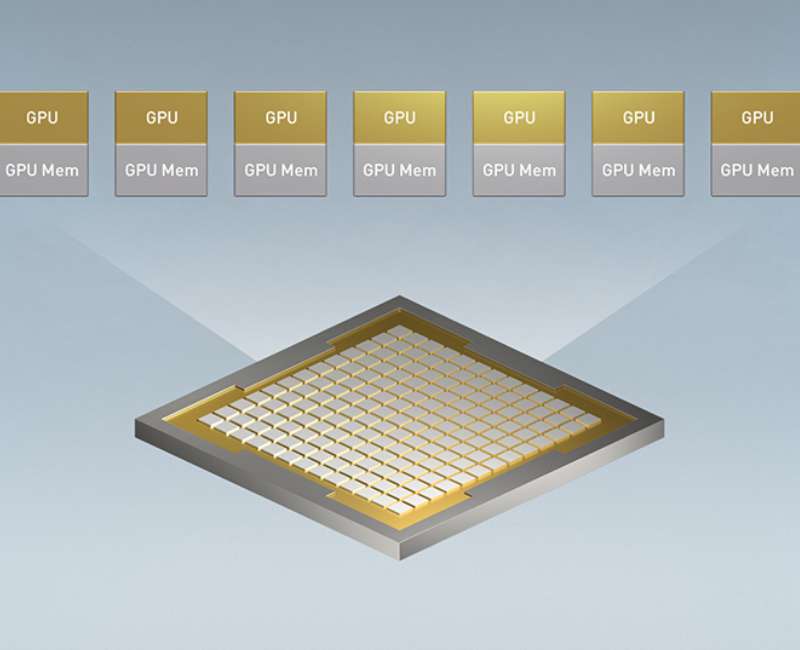

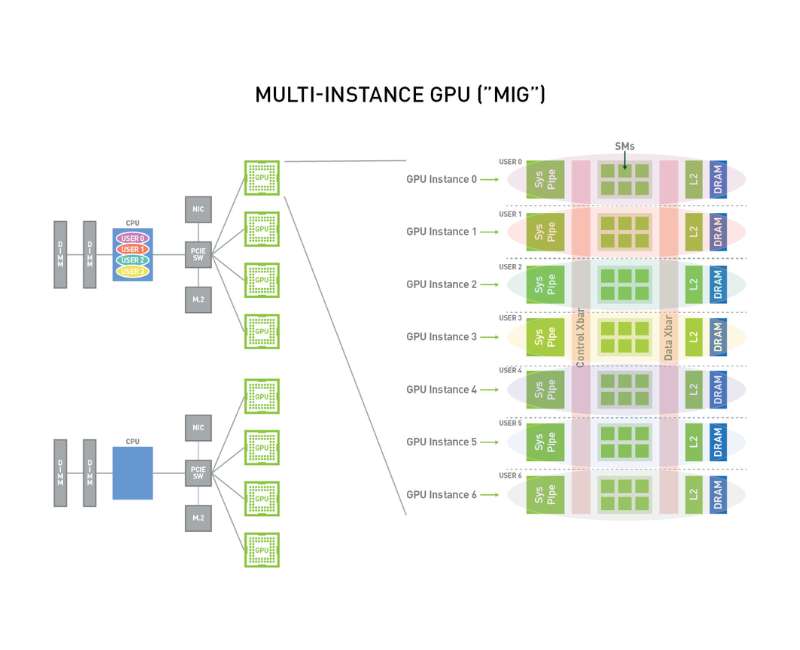

Multi-Instance GPU (MIG) giúp mở rộng hiệu suất và giá trị của từng GPU NVIDIA A100 Tensor Core. Bên cạnh đó, MIG có thể phân chia một GPU NVIDIA A100 duy nhất thành bảy GPU ảo. Trong đó, mỗi GPU ảo được cô lập hoàn toàn với bộ nhớ băng thông cao, bộ nhớ cache và multiprocessors của riêng chúng. Điều này cho phép GPU A100 cung cấp khả năng quality-of-service (QoS) đảm bảo cho mọi công việc, tối ưu hóa việc sử dụng. Đồng thời, mở rộng phạm vi tiếp cận của các tài nguyên xử lý được tăng tốc cho mọi user với mức sử dụng cao hơn gấp 7 lần nếu so với các GPU trước đây.

Ngoài ra, A100 ở chế độ MIG cung cấp sự linh hoạt để chọn nhiều kích thước GPU ảo khác nhau. Hơn nữa, nó có thể chạy với bất kỳ sự kết hợp nào của tối đa bảy tải công việc HPC hoặc AI có kích thước khác nhau. Từ đó, cung cấp GPU ảo có kích thước phù hợp cho mỗi tải công việc. Điều này sẽ có lợi cho các tải công việc không sử dụng hết hoàn toàn khả năng xử lý của GPU. Do đó, bạn có thể muốn chạy các tải công việc khác nhau song song để tối đa hóa mức sử dụng.

Lợi ích của Multi Instance GPU – MIG mang lại

Giúp mở rộng quyền truy cập GPU đến nhiều người dùng hơn

Đối với MIG, bạn có thể đạt được gấp 7 lần tài nguyên GPU trên một GPU A100. Hơn nữa, MIG cung cấp cho các nhà nghiên cứu và nhà phát triển nhiều tài nguyên và tính linh hoạt hơn bao giờ hết.

Tối ưu hóa việc sử dụng GPU

MIG còn cung cấp tính linh hoạt để chọn nhiều kích thước thực thể khác nhau. Đồng thời, cho phép cung cấp các GPU instance có kích thước phù hợp cho từng workload. Nhờ vậy sẽ mang lại hiệu quả sử dụng tối ưu và tối đa hóa đầu tư trung tâm dữ liệu.

Có thể chạy khối lượng công việc hỗn hợp đồng thời

Không những thế, MIG còn cho phép khối lượng công việc suy luận, đào tạo và tính toán hiệu năng cao (HPC) chạy cùng lúc trên một GPU mà có độ trễ và thông lượng xác định.

Công nghệ hoạt động của Multi Instance GPU – MIG như thế nào?

Nếu như không có MIG, các công việc khác nhau sẽ chạy trên cùng một GPU. Ví dụ như các yêu cầu suy luận AI khác nhau, cạnh tranh cùng một tài nguyên như băng thông bộ nhớ. Một tác vụ tiêu tốn băng thông bộ nhớ lớn hơn sẽ khiến các tác vụ khác chết đói, điều này dẫn đến một số tác vụ bị trễ so với mục tiêu. Đối với MIG, các công việc chạy đồng thời trên các thực thể khác nhau. Tuy nhiên, mỗi thực thể có tài nguyên chuyên biệt về xử lý, bộ nhớ và băng thông bộ nhớ. Điều này dẫn đến hiệu suất có thể định đoán được với chất lượng dịch vụ và mức sử dụng GPU tối đa.

Mang đến sự linh hoạt tối đa của trung tâm dữ liệu

Nhận thấy, GPU NVIDIA A100 có thể được phân vùng thành các MIG instance có kích thước khác nhau. Ví dụ quản trị viên có thể tạo hai instance với bộ nhớ 20 gigabyte (GB)/instance hoặc ba instance với 10 GB hoặc bảy instance với 5 GB. Hoặc có thể trộn lẫn nhiều kích cỡ. Do đó, Sysadmin có thể cung cấp GPU có kích thước phù hợp cho người dùng dành cho các loại khối lượng công việc khác nhau.

Đặc biệt, các MIG instance cũng có thể được cấu hình lại một cách linh hoạt. Điều này cho phép quản trị viên thay đổi tài nguyên GPU để đáp ứng nhu cầu thay đổi của người dùng và doanh nghiệp.

Cung cấp chất lượng dịch vụ vượt trội và tiện ích

Mỗi phiên bản MIG sẽ có một bộ tài nguyên phần cứng chuyên dụng để tính toán, bộ nhớ và bộ đệ. Đồng thời, cung cấp chất lượng dịch vụ (QoS) được đảm bảo và cách ly lỗi cho khối lượng công việc. Điều này có nghĩa là lỗi trong một ứng dụng chạy trên một cá thể không ảnh hưởng đến các ứng dụng chạy trên các cá thể khác. Đối với các trường hợp khác nhau có thể chạy các loại khối lượng công việc khác nhau Phát triển mô hình tương tác, đào tạo học sâu cùng với suy luận AI hoặc các ứng dụng HPC. Bởi vì các cá thể chạy song song, nên các khối lượng công việc cũng chạy song song với nhau tuy nhiên tách biệt trên cùng một GPU A100 vật lý.

Bên cạnh đó, MIG rất phù hợp với khối lượng công việc như phát triển mô hình AI và suy luận độ trễ thấp. Đặc biệt, các khối lượng công việc này có thể tận dụng tối đa các tính năng của A100 và sẽ phù hợp với bộ nhớ được phân bổ của từng trường hợp.

Được thiết kế để nhằm phục vụ cho bộ phận IT và DevOps

MIG được xây dựng nhằm dễ dàng triển khai bởi các nhóm IT và DevOps.

Khi đó, mỗi MIG-instance hoạt động giống như một GPU độc lập cho các ứng dụng. Vì thế, không có thay đổi nào đối với nền tảng CUDA®. Bên cạnh đó, các mô hình AI và các ứng dụng được đóng gói HPC, ví dụ như các ứng dụng từ NGC™. Nó có thể chạy trực tiếp trên một cá thể MIG với NVIDIA Container Runtime. Ngoài ra, các phiên bản MIG xuất hiện dưới dạng tài nguyên GPU bổ sung trong bộ điều phối bộ chứa như Kubernetes. Thậm chí có thể lên lịch cho khối lượng công việc được chứa để chạy trong các phiên bản GPU cụ thể. Tính năng này sẽ được cung cấp sớm thông qua plugin thiết bị NVIDIA cho Kubernetes.

Nhờ sở hữu các ưu điểm trên mà các tổ chức có thể tận dụng lợi ích quản lý, cũng như giám sát và vận hành của ảo hóa máy chủ dựa trên nền tảng ảo hóa. Bao gồm cả di chuyển trực tiếp và thuê nhiều người, trên các phiên bản GPU MIG với Máy chủ tính toán ảo NVIDIA (vComputeServer).

Vậy là Shop máy chủ đã giúp bạn tìm hiểu một số thông tin liên quan đến Multi Instance GPU – MIG. Mong rằng bạn đã có cái nhìn tổng quát về vấn đề này. Nếu bạn còn thêm thắc mắc gì hãy liên hệ ngay với Shop máy chủ nhé.