Tìm hiểu về phần cứng nhúng xử lý AI tại biên: GPU, VPU, FPGA và ASIC

Các hệ thống IT doanh nghiệp đang phát triển nhanh chóng và bùng nổ trên diện rộng, và một xu hướng rõ nét đó là sự chuyển dịch sức mạnh xử lý ra rìa mạng. Gartner dự đoán vào năm 2025, điện toán biên sẽ xử lý 75% dữ liệu được tạo ra bởi tất cả các hệ thống ứng dụng, bao gồm cả dữ liệu trong nhà máy, y tế và giao thông vận tải. Bạn có thể thấy sự tương quan giữa việc áp dụng các hệ thống điện toán hiệu suất cao với sự gia tăng của trí tuệ nhân tạo (AI), vốn đang làm cho các nhà máy trở nên thông minh hơn, cải thiện kết quả chẩn đoán bệnh nhân tốt hơn, tăng độ an toàn cho phương tiện tự hành – cùng với đó, cũng làm gia tăng khối lượng dữ liệu theo cấp số nhân. Dữ liệu từ thiết bị sản xuất, cảm biến, hệ thống thị giác máy tính và hệ thống quản lý kho hàng trong một nhà máy thông minh có thể dễ dàng đạt đến mức 1 petabyte mỗi ngày. Khi các doanh nghiệp triển khai các hệ thống nhúng lần đầu, các kiến trúc sư hệ thống của họ không thể hình dung được khối lượng dữ liệu mà AI, IoT (Internet of Things) và các công nghệ tiên tiến khác sẽ tạo ra. Hiện giờ, bối cảnh đã thay đổi, các hệ thống nhúng của mười năm trước phải thích ứng để hỗ trợ xu hướng điện toán tại biên hiện nay. Nhiều tải công việc AI ngày nay được xử lý trên đám mây. Tuy nhiên, vì ngày càng có nhiều dữ liệu sinh ra đặt ra nhu cầu băng thông ngày càng tăng đối với các hệ thống này, việc xử lý dữ liệu ở rìa có ý nghĩa về mặt độ trễ, độ tin cậy, tính di động, bảo mật, hiệu quả năng lượng và chi phí truyền dữ liệu. Để đáp ứng nhu cầu mới này, phần cứng phải phát triển và chuyển từ hệ thống dựa trên điều khiển và theo quy tắc sang môi trường lấy dữ liệu làm trung tâm để phù hợp với các ứng dụng AI tiên tiến.

Giới thiệu về các loại bộ xử lý cho hệ thống AI tại biên

Yêu cầu phần cứng để xử lý tải công việc AI khác nhau tùy thuộc vào ứng dụng cụ thể. AI có thể tận dụng nhiều loại đầu vào, bao gồm video, hình ảnh, âm thanh, cảm biến và dữ liệu PLC. Thách thức mà các kiến trúc sư hệ thống gặp phải là lựa chọn các core xử lý tốt nhất cho các ứng dụng AI của họ.

Bài viết này sẽ giúp bạn hiểu rõ các loại core xử lý khác nhau có thể được sử dụng trong các hệ thống biên, cũng như điểm mạnh của chúng.

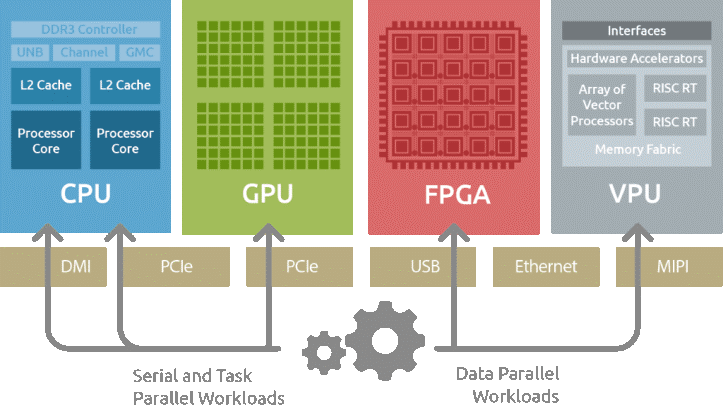

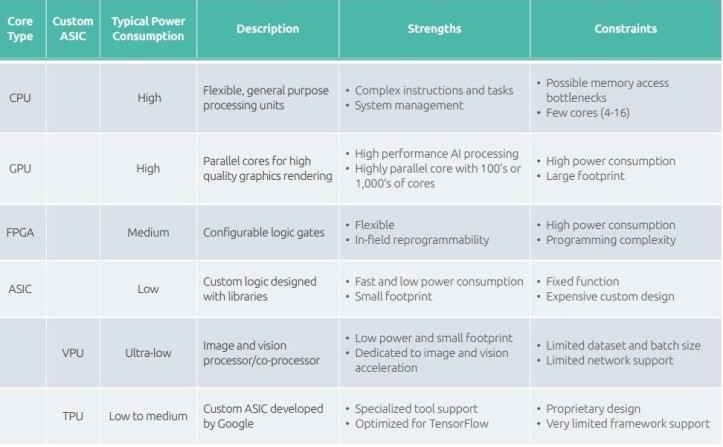

CPU

Central processing unit (CPU) là một đơn vị xử lý đa năng thường có 4-16 lõi. CPU chạy các tác vụ phức tạp và tạo điều kiện thuận lợi cho việc quản lý hệ thống.

Chúng hoạt động tốt với các đầu vào dữ liệu hỗn hợp, chẳng hạn như các hệ thống sử dụng cả âm thanh và văn bản cũng như các quy trình trích xuất, chuyển đổi và tải (Extract – Transform – Load).

GPU

Graphics processing units (GPU) là các lõi có độ song song cao (100 hoặc 1.000) để kết xuất đồ họa tốc độ cao. Chúng mang lại hiệu suất xử lý cao và thường có kích thước lớn hơn và tiêu thụ điện năng cao hơn so với CPU.

Do số lượng lõi nhỏ cao, GPU rất phù hợp với các tải xử lý của AI, tạo điều kiện thuận lợi cho cả đào tạo mạng thần kinh lẫn suy luận AI.

FPGA

Field-programmable gate array (FPGA), là các cổng logic có thể định cấu hình, tiêu thụ ít năng lượng hơn CPU và GPU. Chúng cho phép lập trình lại tại thiết bị (in-field) cho các kỹ sư có chuyên môn về lập trình.

Chúng có thể là sự lựa chọn tốt nhất khi yêu cầu mức độ linh hoạt cao.

ASIC

Application-specific integrated circuits (ASIC) là thành phần xử lý logic tùy biến được thiết kế bằng cách sử dụng thư viện mạch của nhà sản xuất và cung cấp các lợi thế về tiêu thụ điện năng thấp, tốc độ và ít footprint. Tuy nhiên, chúng tốn thời gian để thiết kế và đắt hơn các tùy chọn khác, vì vậy ASIC được khuyến nghị cho các sản phẩm sẽ chạy với khối lượng rất lớn.

Các loại ASIC bao gồm các loại:

- Vision processing unit (VPU), bộ xử lý hình ảnh và thị giác, và các bộ đồng xử lý

- Tensor processing unit (TPU), chẳng hạn như TPU đầu tiên được Google phát triển cho framework học máy của họ, TensorFlow

- Neural compute unit (NCU), gồm có những thiết kế đến từ ARM

Mỗi loại core phù hợp với các kiểu xử lý khác nhau – và việc sử dụng chúng cùng nhau trong các ứng dụng xử lý không đồng nhất (heterogeneous) sẽ cung cấp tất cả các chức năng mà các ứng dụng phức tạp yêu cầu. Được sử dụng cùng nhau, chúng cũng có thể cân bằng tải xử lý, tăng các mức hiệu suất suy luận AI khác nhau và thiết lập cấu hình hiệu quả và tiết kiệm chi phí nhất.

Các bước để chọn phần cứng nhúng cho Edge AI

Việc lựa chọn một hệ thống phần cứng biên được nhúng để xử lý AI ở biên thường yêu cầu đánh giá ba yếu tố chính:

Hiệu năng

Hệ thống phần cứng cốt lõi phải có khả năng cung cấp tốc độ mà các ứng dụng AI phức tạp và đòi hỏi nhiều dữ liệu trong khi vẫn hoạt động ổn định và đáng tin cậy, ngay cả ở trong môi trường khắc nghiệt.

SWaP

SWaP là từ viết tắt của Size, Weight và Power. Ngoài việc cung cấp chức năng mà ứng dụng yêu cầu, phần cứng biên cũng phải đáp ứng các thông số kỹ thuật về kích thước và trọng lượng để tuân thủ các ràng buộc vật lý của ứng dụng và có ý nghĩa nhất từ quan điểm tiêu thụ điện năng.

Chi phí

Chi phí của phần cứng biên có thể khác nhau – giữa các loại core, và giữa các nhà sản xuất với nhau. Cần phải xác định cái nào cung cấp chức năng và thông số kỹ thuật mà dự án của bạn cần ở mức chi phí tốt nhất.

Phần cứng Edge tại nơi vận hành

Các ví dụ sau đây chỉ là một vài trong số rất nhiều trường hợp ứng dụng trong đó phần cứng biên cho phép AI mang lại giá trị hữu ích cho doanh nghiệp ngày nay.

Nền tảng tăng tốc học sâu

Deep learning acceleration platform (DLAP) cho phép thực hiệ các chức năng, bao gồm thu thập dữ liệu, xử lý trước hình ảnh, phân tích hình ảnh và tăng tốc AI. Chúng cũng cung cấp cho máy móc khả năng cải thiện hiệu suất của chính chúng và đưa ra quyết định. Bằng cách thay thế các thiết bị biên cũ gửi dữ liệu lên đám mây để xử lý bằng DLAP, các hoạt động có thể cho thấy có phản hồi nhanh hơn cũng như khả năng kiểm soát và bảo mật cao hơn.

Các DLAP có thể tận dụng thiết kế không đồng nhất, chẳng hạn như sử dụng CPU để quản lý việc thu thập dữ liệu và xử lý trước hình ảnh và GPU để tăng tốc độ xử lý tác vụ song song trong khi vẫn giữ cho hệ thống biên nhỏ và tiết kiệm điện.

Ví dụ: DLAP Series của ADLINK, được thiết kế để hoạt động trong môi trường công nghiệp hoặc môi trường nhúng khắc nghiệt, hoạt động ở nhiệt độ khắc nghiệt, độ ẩm cao và trong các trường hợp sử dụng thường xảy ra chấn động và rung lắc; chúng tôi gọi đây là SWaP được tối ưu hóa cho AI tiên tiến. Các thiết bị nhỏ gọn từ ADLINK chứa GPU nhúng NVIDIA® Quadro® hoặc siêu máy tính mini NVIDIA® Jetson™ trên một mô-đun và có thể được sử dụng cho các ứng dụng suy luận dựa trên AI, thị giác máy tính và điều khiển máy tự động.

Một vài ví dụ

Tự thanh toán (Self-checkout) với AI: Với những bữa trưa nhàn nhã đã trở thành dĩ vãng, mọi người đang tìm kiếm những cách nhanh chóng để mua một phần ăn trưa. Việc áp dụng dịch vụ tự phục vụ đang ngày càng phổ biến giữa người tiêu dùng và AI có thể hiện đại hóa trải nghiệm của khách hàng. Khi thanh toán cho nhà hàng hoặc cửa hàng, Computer Vision có thể xác định các mặt hàng trong một lần quét và hiển thị tổng số tiền đến hạn. Khách hàng có thể hoàn thành việc mua hàng của mình một cách nhanh chóng và tiện lợi.

Mobile X-Ray C-Arm: Thiết bị y tế phải đảm bảo tin cậy, bền và được thiết kế để đạt hiệu suất cao. Thiết bị di động cũng phải đóng gói tất cả khả năng tính toán cần thiết vào một thiết kế nhỏ gọn với mức tiêu thụ điện năng thấp. Sự kết hợp giữa CPU và mô-đun GPU MXM nhúng, hệ thống hỗ trợ GPU công nghiệp nhỏ nhất thế giới, đáp ứng các thông số kỹ thuật đó.

AI trên module

GPU dành cho mô-đun PCI Express di động (MXM) cho phép bạn chạy AI trong các cạc đồ họa có kích thước bằng lòng bàn tay. Họ cung cấp các lợi thế SWaP chính, bao gồm kích thước chỉ bằng một phần nhỏ của thẻ PEG có chiều dài đầy đủ. Chúng cung cấp hiệu suất cao trên mỗi watt và chúng được thiết kế cho các điều kiện khắc nghiệt, chẳng hạn như hạn chế hoặc không có thông gió, không gian nhỏ, nhiệt độ cao hoặc thấp và môi trường có bụi hoặc thậm chí ăn mòn.

Các ví dụ

Nhận dạng khuôn mặt AI: Việc kiểm soát ra vào là rất quan trọng để ngăn chặn sự xâm nhập trái phép vào các nhà máy sản xuất, cơ sở nghiên cứu, trung tâm dữ liệu và các khu vực được kiểm soát cao khác. Cổng nhận dạng khuôn mặt AI giúp loại bỏ nhu cầu về thẻ ID (có thể bị làm giả) và thay thế các hệ thống kế thừa đó bằng công nghệ xác định người dùng được ủy quyền, ngay cả khi họ đeo kính hoặc đội mũ lưỡi trai, trong vòng dưới một giây. Nó thậm chí có thể phân biệt giữa khuôn mặt người thật và một bức ảnh.

An ninh sân bay: Hệ thống giám sát toàn cảnh sân bay cung cấp tầm nhìn 360 độ về đường băng, giao thông trên không và mặt đất, đồng thời nhận thức tình huống ở mức độ cao hơn so với các hệ thống giám sát cũ. Các công nghệ AI này được hỗ trợ bởi một thiết bị biên không quạt (fanless) chắc chắn, được thiết kế để sử dụng ngoài trời, tích hợp với GPU hiệu suất cao hỗ trợ cải thiện khả năng giám sát cả ngày và đêm.

Edge Robotics

Sự đổi mới phần cứng cũng đang làm cho việc chế tạo robot trở nên khả thi. Bạn có nghe nói đến Eclipse Cyclone DDS đã được chọn làm middleware ROS 2 mặc định? Điều này thật thú vị vì đó là cùng một công nghệ Dịch vụ phân phối dữ liệu (DDS) trong bộ điều khiển rô bốt nhúng ROScube, giúp robot giao tiếp với bản thân và thế giới xung quanh.

Ví dụ:

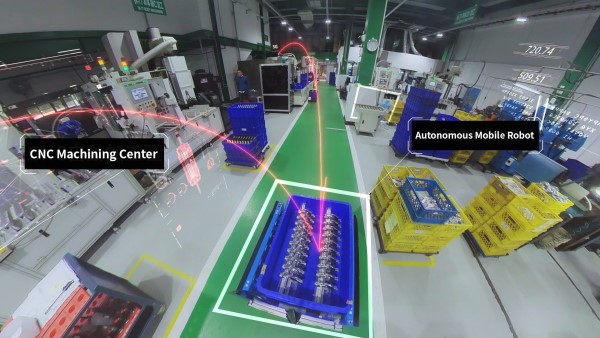

Autonomous Mobile Robot trong lĩnh vực sản xuất: AMR được hỗ trợ bởi AI tiên tiến có thể cảm nhận môi trường của chúng và hiểu bối cảnh bằng cách sử dụng thị giác máy tính, công nghệ 5G và DDS. Fair Friend Group, một trong những nhà sản xuất lớn nhất ở Đài Loan đang sử dụng 5G qua cơ sở hạ tầng DDS để cho phép bảo trì từ xa với thực tế tăng cường (AR), thị giác máy tính để kiểm tra tự động và các AMR swarms để xử lý vật liệu trong nhà máy của họ ngày nay.

AI Machine Vision

Hệ thống Machine Vision dựa trên AI tận dụng các camera công nghiệp tích hợp và hệ thống điện toán biên với các GPU, VPU và CPU hiệu suất cao được nhúng để thực hiện các tác vụ. Bởi vì tất cả sức mạnh xử lý đều ở mức cao nhất, các lo ngại về độ trễ và băng thông được loại bỏ. Ngoài ra, với phần cứng biên phù hợp, các camera thông minh có thể duy trì các yêu cầu nhỏ về footprint, trọng lượng, điện năng, hiệu suất và chi phí cho thị giác máy tính dựa trên AI.

Ví dụ:

Warehouse Fulfillment: Evans Distribution Systems, một công ty chuỗi cung ứng và kho vận bên thứ ba đang sử dụng hệ thống thị giác máy tính AI để hoàn thành nhanh chóng và chính xác các đơn đặt hàng bánh quy Girl Scout cho Girl Scouts of America, một trong những công ty gây quỹ phổ biến nhất cho các tổ chức phi lợi nhuận nổi tiếng. Theo một cuộc phỏng vấn gần đây, hệ thống có độ chính xác trên 99,8%, cải thiện năng suất và các lô hàng chính xác của khách hàng.